Die Playlist über Sprache aufrufen, Hausaufgabenunterstützung durch ChatGPT oder Google Gemini, Bildbearbeitung über DALL-E und Midjourney oder Informationsbeschaffung durch Chatbots – weit mehr als die Hälfte der Jugendlichen nutzt schon heute aktiv Anwendungen, die auf Künstlicher Intelligenz (KI) basieren. Das unterscheidet die sogenannten »Digital Natives« von vielen Akteuren in der Sozialwirtschaft.

Zum Thema Künstliche Intelligenz befragt, beurteilen Führungskräfte sozialer Organisationen ihren Kenntnisstand – einer Studie zur KI in der Sozialwirtschaft zufolge – mehrheitlich als mittelmäßig. Aktuell liegt die tatsächliche Nutzung von KI-Anwendungen im Mittelwert über alle Anwendungsformen hinweg bei 13 Prozent. Dass KI viele Herausforderungen der Branche, wie Fachkräftemangel oder Automatisierung, abfedern kann, scheint dagegen Konsens. 75 Prozent der Befragten können sich vorstellen KI zu nutzen, nur 12 Prozent lehnen dies ab. Aber wie kann die Sozialwirtschaft KI sorgfältig einführen und nutzen? »Mit Augenmaß«, sagt Thomas Althammer, Geschäftsführer des Beratungsunternehmens Althammer & Kill.

KI ist gekommen, um zu bleiben

Sie wird unseren Arbeitsalltag durch ihre disruptive Kraft – ähnlich wie damals das Internet – maßgeblich verändern. Auch wenn sich Digitalisierung und die Nutzung von KI in der Sozialwirtschaft vielerorts noch in den Anfängen befindet – es wäre die falsche Strategie, sich nicht damit auseinanderzusetzen. Viele Organisationen experimentieren bereits mit Tools wie ChatGPT, Microsoft Copilot oder KI-gestützten Dokumentationssystemen, jedoch sind tiefgreifende Lösungen mit holistischen (ganzheitlichen) IT-Strategien noch selten. Besonders das mittlere Management treibt Innovationen voran, während die Geschäftsführung oft noch zögert, wie eine Studie zu KI in der Sozialwirtschaft zeigt, an der Althammer & Kill mitwirkte. Dabei kann KI in der eigenen Organisation und bei der Arbeit mit Kindern und Jugendlichen einiges bewirken:

- Effizienzsteigerung bei administrativen Aufgaben: KI kann Routineaufgaben wie Protokollierung, Berichterstellung und Dokumentation erleichtern. Dadurch bleibt mehr Zeit für die direkte Arbeit mit Kindern, Jugendlichen und Familien.

- Verbesserte Teilhabe: Übersetzungs- und Unterstützungsfunktionen fördern die Integration von Kindern, Jugendlichen und Familien mit Sprachbarrieren oder besonderen Bedürfnissen.

- Förderung von Kreativität und Innovation: Mit generativen KI-Tools (Text, Bild, Video, Audio) können Jugendarbeitende, Kinder und Jugendliche gemeinsam Inhalte produzieren und kreative Projekte umsetzen. Das stärkt technische Fertigkeiten und Problemlösungskompetenzen.

- Niedrigschwelliger Zugang zu Information und Unterstützung: Chatbots und KI-gestützte Assistenten machen Informationen, Hilfsangebote oder Lerninhalte leicht zugänglich und können zum Beispiel bei Bewerbungen oder Anträgen unterstützen.

- Selbstwirksamkeit und kritisches Denken: Kinder und Jugendliche lernen, digitale Werkzeuge kritisch zu nutzen, ihre eigenen Kompetenzen einzuschätzen und medial reflektiert zu agieren.

Auf der anderen Seite stellen sich viele ethische, datenschutzrechtliche und fachliche Fragen beim Einsatz von KI:

- Datenschutz und Privatsphäre: Die Nutzung von KI erfordert einen sensiblen Umgang mit personenbezogenen Daten.

- Bias und Diskriminierung: KI-Systeme können Vorurteile oder diskriminierende Muster reproduzieren, wenn sie mit einseitigen Daten trainiert wurden. Das erfordert eine bewusste Auswahl und Kontrolle eingesetzter Tools.

- Qualitätskontrolle und Verantwortlichkeit: Die automatische Generierung von Inhalten birgt das Risiko, falsche oder ungeprüfte Informationen zu verbreiten. Inhalte sollten daher immer kritisch geprüft und durch Menschen validiert werden.

- Kompetenzgefälle und Zugang: Nicht alle Kinder, Jugendlichen oder Fachkräfte verfügen über ausreichend digitale Kompetenzen oder Zugang zu aktuellen Technologien.

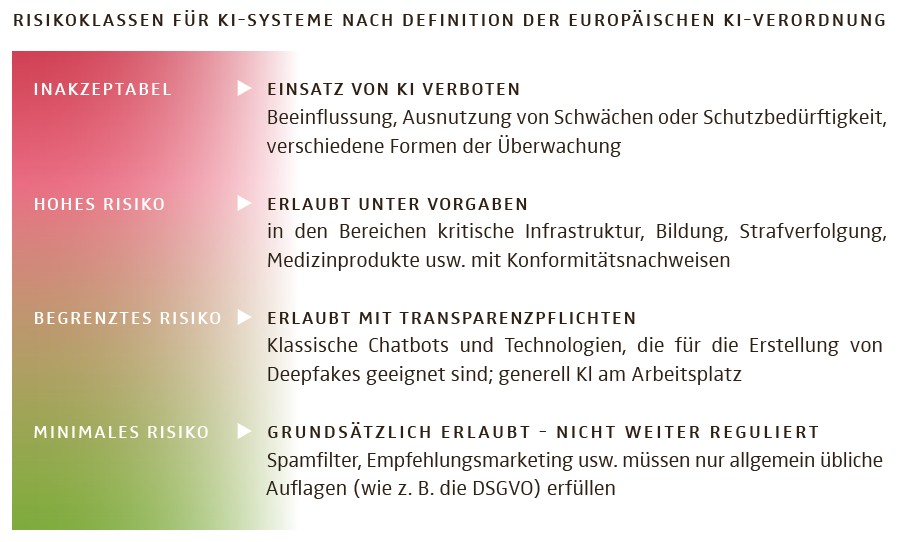

Die europäische KI-Verordnung reguliert den Einsatz von KI

Mit der Verabschiedung der KI-VO hat die EU einen einheitlichen Rechtsrahmen für den Umgang mit Künstlicher Intelligenz geschaffen. Die KI-VO reguliert Betreiber von KI-Systemen, die im EU-Binnenmarkt tätig sind. Ausgenommen sind militärische Anwendungen sowie reine Forschung und Entwicklung. Wie in der Abbildung dargestellt, folgt die KI-Verordnung einem risikobasierten sowie menschenzentrierten Ansatz. Je höher das Risiko, desto strenger sind die Anforderungen an KI-Anwendungen. Es wird unterschieden zwischen verbotenen KI-Praktiken, Hochrisiko-KI-Systemen, KI-Systemen mit geringem Risiko und sogenannten »General Purpose«-KI-Systemen wie ChatGPT, die in unterschiedlichen Kontexten und für verschiedene Zwecke genutzt werden.

Wie kann der richtige Umgang mit KI gelingen? Pilotprojekte als Testfeld

Sozialunternehmen müssen sich entscheiden, ob sie KI über »learning by doing« einführen oder über ein geplantes Vorgehen mit umfassender Beratung. Viele werden erst einmal abwarten und die weitere Entwicklung beobachten. Wir raten unseren Kunden zu Pilotprojekten. Dabei sollten die Einführung in drei Phasen (siehe folgende Seite) strategisch geplant, ethische Fragestellungen einbezogen und alle regulatorischen und organisatorischen Anforderungen auf den Weg gebracht werden.

Alsdann können erste kleine Pilotprojekte gestartet und im Prozess das Personal geschult werden. Dafür eignen sich zum Beispiel die Automatisierung von Dokumentation oder die Personalplanung. Hier frühzeitig Risiken zu erkennen, wenn zum Beispiel Personalengpässe an Feiertagen wegen Urlaub und Krankheit drohen, ist enorm hilfreich. Bei Branchen, die viel beraten, sind Chatbots ein gutes Versuchsfeld. Sie verlängern die Erreichbarkeit über Sprechzeiten hinaus und können Hilfestellung bei häufig auftretenden Fragen geben.

Zur Einbindung von Dienstleistern kennt die Datenschutzgrundverordnung (DSGVO) Verträge zur Auftragsverarbeitung und Verarbeitung in gemeinsamer Verantwortung. Diese ist dann anzunehmen, wenn der Auftraggeber nicht allein über Mittel und Zweck der Verarbeitung entscheidet, was häufig für KI-basierte Systeme gelten dürfte. Wenn der KI-Anbieter aufgrund des Nutzungsverhaltens der Kunden sein System weiter verbessern und optimieren möchte, ist das ein eigener Zweck und der KI-Anbieter wird selbst zu einer verantwortlichen Stelle. All dies und viele weitere Aspekte müssen bedacht werden und finden Eingang in dieses 3-Phasen-System:

Phase 1: Der KI-Readiness-Check

Die richtige Einschätzung der vorliegenden Daten und Prozesse ist essenziell, um für einen verantwortungsvollen Einsatz zu sorgen. Dazu gehören Analysen des Datenschutzes, der IT-Sicherheit (gerade im Hinblick auf die zunehmende Cyberkriminalität) und eine Prüfung der Kompetenzen im Haus. Das Praxis-Know-how externer Berater kann diese Prozesse schneller zum Abschluss bringen.

Phase 2: KI-Projekt-Assessment

Im KI-Assessment werden für konkrete Anwendungsfälle wie ChatGPT oder Microsoft Copilot frühzeitig die Potenziale analysiert, gegen die Risiken abgewogen und die Voraussetzungen für eine erfolgreiche Implementierung zusammengefasst. Anhand eines Maßnahmenplans kann so auf die rechtskonforme Implementierung geachtet werden.

Phase 3: KI-Risikomanagement

Verschiedene KI-Lösungen sollten hinsichtlich Funktionalität, Skalierbarkeit und Kompatibilität mit vorhandenen Systemen evaluiert werden. Welche Daten nutzt die KI, wie kommt sie zu Ergebnissen, welche Kontrollmechanismen gibt es, wer sorgt für IT-Sicherheit und Einhaltung der Unternehmens-Compliance? Diese Fragen müssen laufend bewertet und überprüft werden, auch im Kontext der sich entwickelnden Rechtslage, z.B. mit Grundrechte- und Datenschutz-Folgenabschätzungen.

Die Entwicklung und Implementierung von KI-Funktionen muss sich an wechselnde Umgebungsbedingungen anpassen und der hohen Entwicklungsgeschwindigkeit Rechnung tragen. Es ist übrigens ein Irrglaube, dass der Einsatz von KI im Gesundheits- und Sozialwesen nicht mit den Grundsätzen des Datenschutzes zu vereinbaren sei. Durch Nutzung von Technologien wie Retrieval-Augmented-Generation (Abgleich mit verifizierten Daten) ist der verantwortungsvolle Einsatz von KI in Verbindung mit personenbezogenen Daten möglich. Halluzinationen (KI-generierte Falschinformationen) können begrenzt und die Verwendung bestehender Datenquellen in den Einrichtungen unter Beachtung der Vorgaben der Datenschutzgesetze integriert werden.

Mit Augenmaß agieren

Die Einführung von KI-Systemen ist für Einrichtungen der Sozialwirtschaft eine komplexe Herausforderung. Durch ihre disruptive Kraft werden maschinelles Lernen und neuronale Netze unseren Arbeitsalltag künftig branchenübergreifend verändern und tun dies auch heute schon. Führungskräfte und Verantwortliche werden sich mit dem Umgang mit KI auseinandersetzen müssen, um Chancen und Risiken der Technologie bestmöglich auszubalancieren. Sie müssen einen ausgewogenen Ansatz finden, um an Innovation und Fortschritt zu partizipieren, ohne die ethischen Grundsätze und die Verantwortung für ihre junge, technik-affine Zielgruppe aus den Augen zu verlieren.

Über den Autor: Thomas Althammer ist Geschäftsführer des 40-köpfigen Beratungsunternehmens Althammer & Kill GmbH & Co. KG, das an der Schnittstelle von Recht & Technik aktiv ist, z. B. mit der Stellung externer Datenschutzbeauftragter und externer Informationssicherheitsbeauftragter sowie Beratungsangeboten im Umfeld von KI und Compliance. Thomas Althammer ist Lehrbeauftragter an der Kath. Universität Eichstätt-Ingolstadt und der Hochschule Hannover sowie Co-Leiter der Fachgruppe IT-Compliance bei FINSOZ e.V.

©Bilder: Althammer & Kill